こんにちは!管理人Kです。

近年、AI(人工知能)は急速に進化しさまざまなビジネス分野で活用されています。(私も日頃からChatGPTやDeepLなどのサービスを活用しています。)

これまで手作業で行なっていた作業をまるっとお任せできたりもするのでとても便利な反面、実は気をつけておかないと「知らないうちに個人情報や社内の機密情報などが漏れてしまった・・!」なんてことも起こり得ます。

今回は、AIを安全に活用するために注意すべきことを解説します!

AIって危険なの?4つのセキュリティリスク

「AIってなんか怖い」「危なそう」と心配される方も少なくないと思いますが、ナイフや包丁のようなもので、適切な取り扱い方を身に付ければ怪我や事故を未然に防ぐことができます。

それでは、一体どんなことに気をつければいいのか?

まずはAIを使ったクラウドサービス(以下AIツール)の主なセキュリティリスク4つを見ていきましょう!

1. 個人情報や機密情報の漏洩

AIツールを使用する際、個人情報や社内の機密情報が意図せず第三者に漏洩するリスクがあります。

たとえば、AIに顧客のデータやプロジェクトの詳細を入力すると、それが保存されたり、第三者にアクセスされたりする可能性があります。

これは、AIツールがデータをクラウドに保存する際のセキュリティが不十分な場合や、サービス提供者がデータを他の目的で使用する場合に発生します。

2. データの保存と利用に関するリスク

AIツールがデータをどのように保存し、利用するかに関するリスクがあります。

ユーザーが入力したデータが適切に管理されていない場合、個人情報や機密情報が外部に漏洩する可能性があります。

たとえば、AIツールのプライバシーポリシーが不明確であったり、データの保存場所が安全でない場合に、このリスクが高まります。

3. 著作権侵害

AIは既存のデータを学習して新しいコンテンツを生成するため、意図せず著作権を侵害する可能性があります。

生成されたコンテンツが他者の著作物を含む場合、法的トラブルに発展することがあります。

たとえば、AIが既存のアートワークを参考にして新しい画像を生成した場合、その画像がオリジナル作品に酷似していることが問題になることがあります。

4. 偏った情報の生成

AIは学習データに基づいてコンテンツを生成するため、元のデータが偏っている場合、生成される情報も偏るリスクがあります。

これにより、不正確な情報やバイアスのかかった内容が生成されることがあります。

たとえば、特定の観点や偏見に基づいたデータセットで学習したAIが、同様に偏った記事や報告書を生成する可能性があります。

これらの4つのリスクについて、日頃から意識することがとっても大切なんです。

AIのセキュリティリスクを軽減するための対策

主なセキュリティリスクがわかったところで、対策について解説していきます。

「技術的な難しいことを求められても困るんだけど・・。」と言う人でも大丈夫です!

AIツールに限らず様々なITシステムやクラウドサービス全般に言えることですが、基本的な対策を徹底することで、セキュリティリスクを大幅に軽減できるんです!

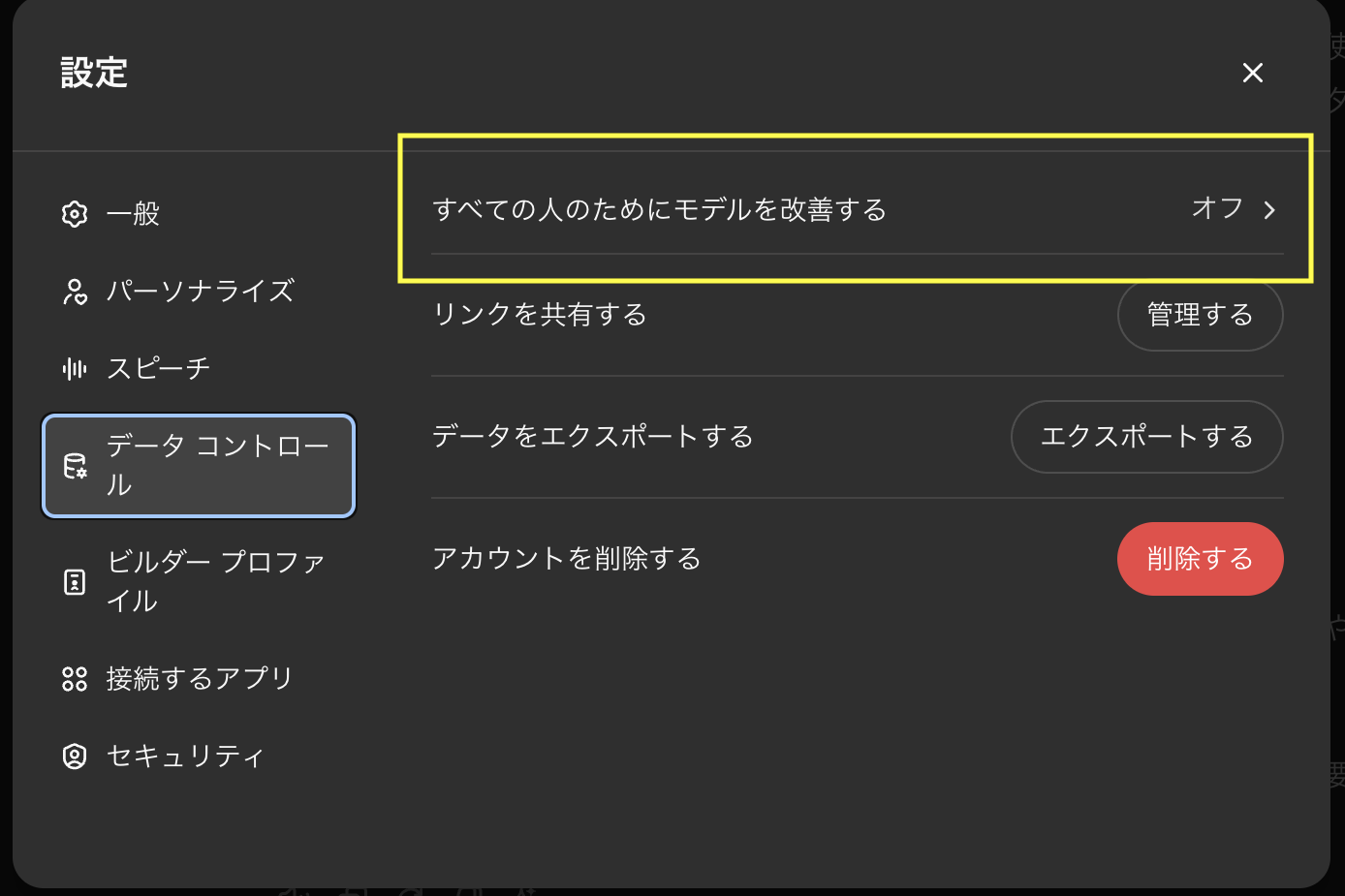

1. プライバシー設定を確認しよう!

使用するAIツールのプライバシー設定を確認し、入力したデータが他の目的で使用されないように設定しましょう。多くのAIツールは、データの利用に関する設定オプションを提供しています。

データが学習モデルに使用されないようにする設定がある場合は、それを有効にします。

例えば、ChatGPTだとこんな画面です↓

ワンクリックで設定できるので、パパッと設定変更しておきましょう!

2. 個人情報・機密情報の入力は避けよう!

AIツールに入力するデータには、個人情報や社内の機密情報を含まないように注意しましょう。

特定の人物やプロジェクトの名前、固有名詞、詳細な住所などを入力するのは避け、必要最低限のデータだけを提供することで、漏洩リスクを最小限に抑えます。

3. 生成されたコンテンツの内容を必ずチェックしよう!

生成されたコンテンツは必ず確認し、誤情報や不適切な内容が含まれていないかをチェックします。

特に公開する前には、内容を慎重にレビューし、必要に応じて修正しましょう。これにより、誤情報の拡散や著作権侵害のリスクを回避できます。

4. 信頼性の高いツールを選定しよう!

AIツールを選ぶ際には、セキュリティとプライバシーに関する認証を確認します。

ISO/IEC 27001やSOC 2、Pマークなどの認証を持つツールは、信頼性が高いと評価できます。また、ユーザーレビューや評価も参考にして、信頼性の高いツールを選びましょう。

もう一段レベルアップしたい人は、「データの保存先」を調べてみましょう!

AIツールがどこにデータを保存しているかを確認することも、セキュリティ対策の一環として非常に重要です。多くのクラウドサービスは、データセンターの場所やデータ保護ポリシーを公開しています。これらの情報を確認することで、データが適切に保護されているかを判断できます。

チェックポイント:

- データセンターの所在地:

- データが保存されている国や地域の法規制を確認しましょう。国によってはデータ保護法が異なり、プライバシー保護のレベルが違うことがあります。

- データ暗号化:

- データが保存される際に暗号化されているかどうかを確認します。暗号化は、データが不正にアクセスされた場合でも、内容が保護される重要な対策です。

- アクセス制御:

- 誰がデータにアクセスできるか、アクセス権限がどのように管理されているかを確認しましょう。適切なアクセス制御が実施されていることが重要です。

5. 自社のルールを再確認しよう!

これは当然のことですが、自社のITポリシーやデータ取り扱いガイドラインに従い、承認されたAIツールのみを使用するようにしましょう。

社内で承認されていないにも関わらずユーザーが独自に導入したIT機器やシステム、クラウドサービスなどをシャドーITと呼びます。

シャドーITが常態化すると、情報漏洩などのセキュリティインシデントが発生した際の原因究明・問題解決が非常に困難となります。

初動の遅れが思わぬ大事故に繋がりますので、AIツールを使用する際は、IT部門やセキュリティ担当者に相談し、安全なツールを選定することが重要です。また、自社のルールを定期的に見直し、最新のセキュリティガイドラインに従うようにしましょう!

まとめ

AIツールの利用が日常業務においてますます一般的になっていますが、その利便性の裏にはいくつかのセキュリティリスクが存在します。

この記事で紹介した主なリスクとしては、個人情報や機密情報の漏洩、データの保存と利用に関するリスク、著作権侵害、偏った情報の生成が挙げられます。

これらのリスクに対処するためには、以下の基本的な対策を徹底することが重要です。

- プライバシー設定を確認しましょう

- 個人情報・機密情報の入力を避けましょう

- 生成されたコンテンツの内容を必ずチェックしましょう

- 信頼性の高いツールを選定しましょう

- 自社のルールを再確認しましょう

これらの対策を実施することで、AIツールの利便性を最大限に活用しながら、セキュリティリスクを最小限に抑えることができます。

安全にAIツールを利用するための基本をしっかりと押さえ、日々の業務に是非お役立てください!

自動議事録作成サービスの活用で業務効率を向上!

AIツールを活用することで、業務の効率化が図れます。

特に、自動議事録作成サービスは会議内容を自動的に記録し、後から簡単に検索・参照できるため、非常に便利です。セキュリティリスクを理解しつつ、安全にこれらのサービスを活用することで、ビジネスの生産性を大幅に向上させることができます。

自動議事録作成サービスの詳細な比較記事はこちらからご覧ください!